War 2024 noch geprägt vom Experimentieren mit generativer KI, so stand 2025 ganz im Zeichen der Implementierung, der Regulierung und der ersten echten Bewährungsproben im klinischen Alltag.

Ein Blick in unser Blog-Archiv zeigt: Künstliche Intelligenz ist in der Versorgung angekommen – aber die Herausforderungen verlagern sich von der Technik hin zu Struktur und Ethik. Besonders deutlich wurde in den vergangenen zwölf Monaten, dass KI keine abstrakte Zukunftsmusik mehr ist, sondern in spezifischen Fachbereichen bereits konkrete Probleme löst.

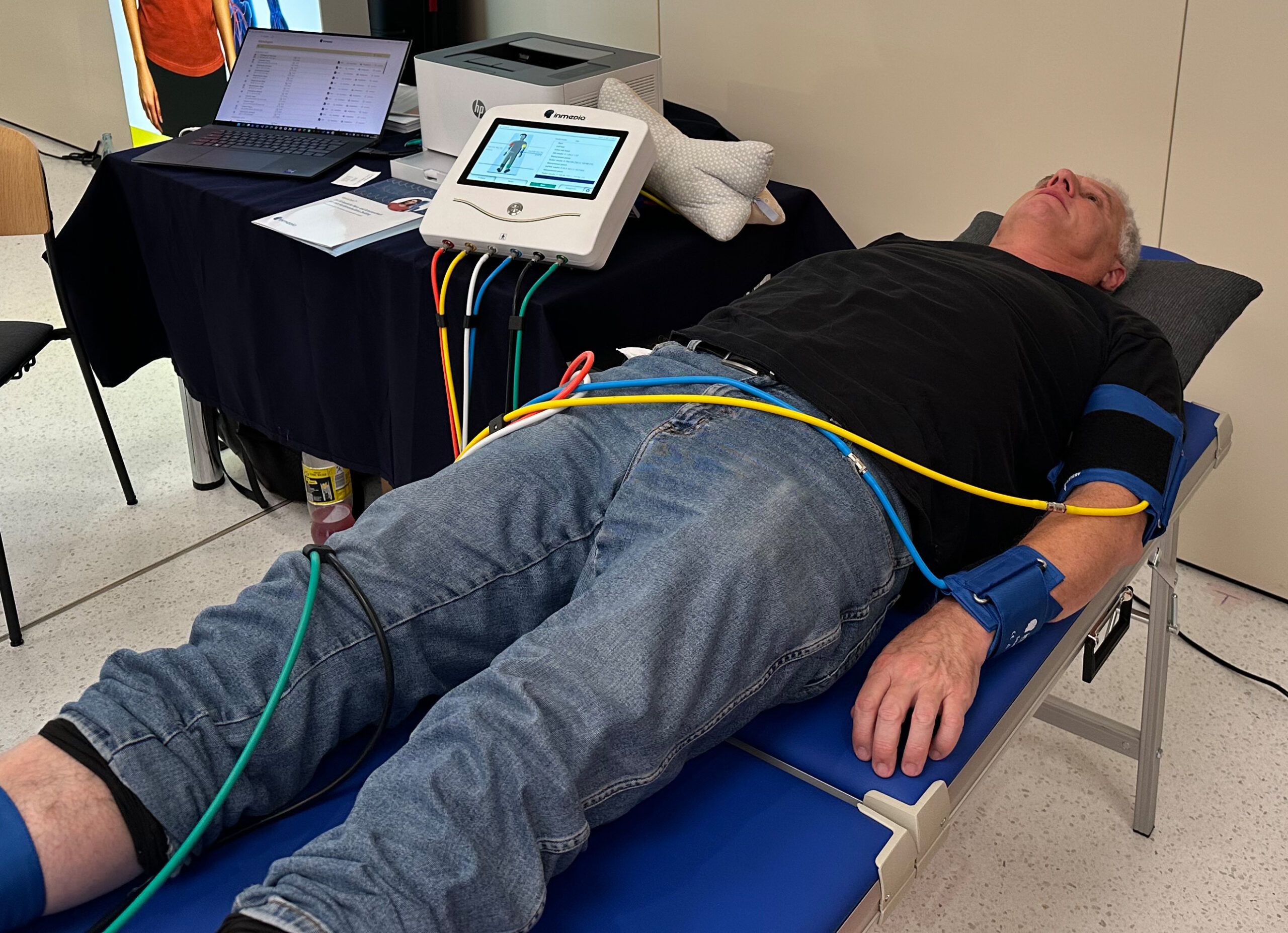

Der Bericht über das hessische Projekt ai4rare zeigte, wie Algorithmen helfen können, die „diagnostische Odyssee“ für Patienten mit seltenen Erkrankungen zu verkürzen, indem sie komplexe Aktenberge strukturieren und Zusammenhänge erkennen, die im menschlichen Arbeitsalltag unterzugehen drohen. Wie nah die Technologie inzwischen am Patienten ist, durften wir im Dezember buchstäblich am eigenen Leib erfahren. Auf dem Jahreskongress der Deutschen Hochdruckliga wagte unser Redakteur einen Selbstversuch mit einer KI-basierten Funktionsdiagnostik. Innerhalb von nur zwölf Minuten erstellte das System mittels oszillometrischer Manschetten einen „kardiovaskulären Zwilling“. Das Ergebnis war kein kryptischer Datensatz, sondern ein präziser Bericht über Arteriensteifigkeit und Herzinsuffizienz-Risiko – ein eindrucksvoller Beweis, dass der „Digital Twin“ den Sprung von der Theorie in die messbare Praxis geschafft hat.

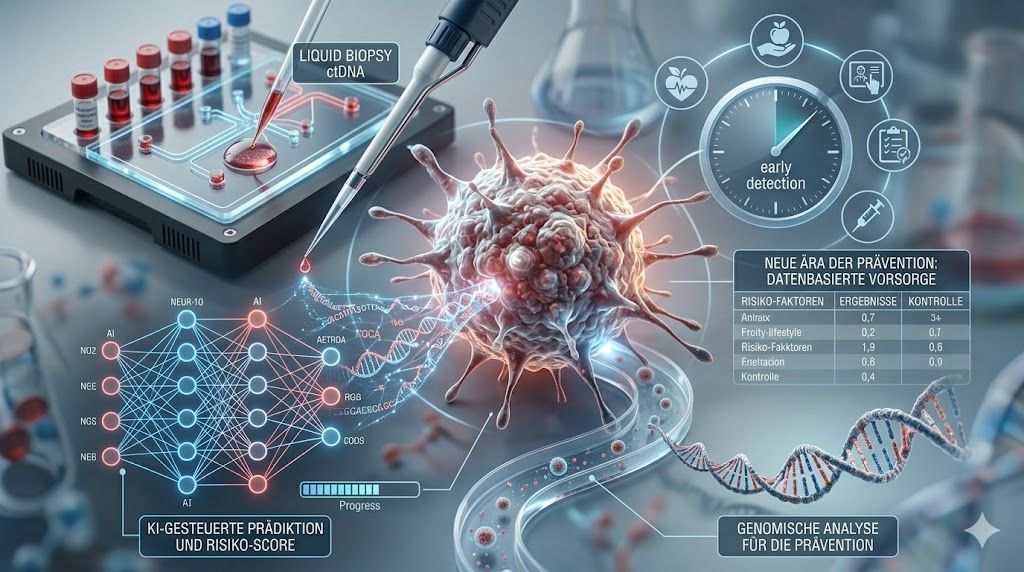

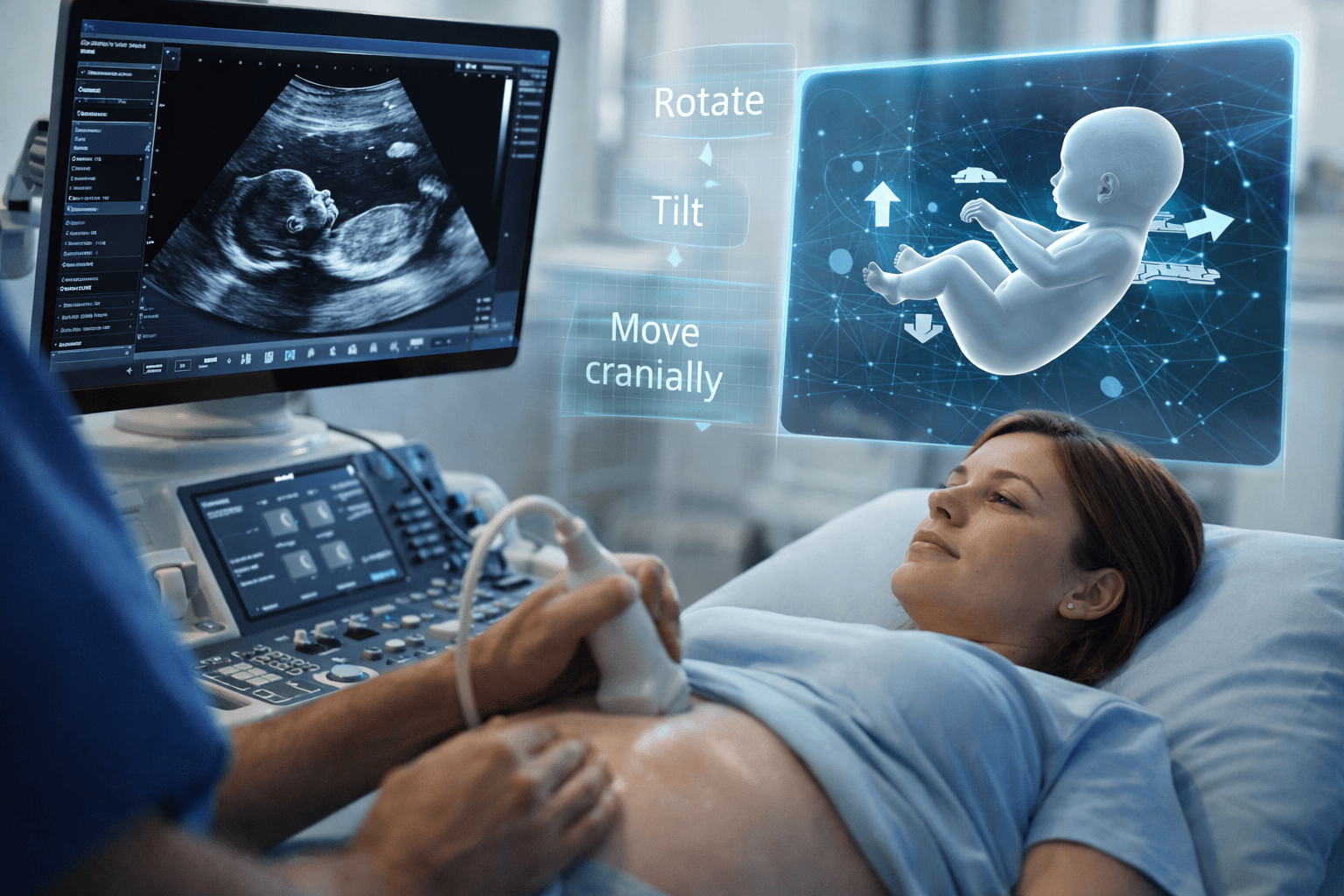

Diese Entwicklung zieht sich wie ein roter Faden durch das Jahr. Bereits im Frühjahr beleuchteten wir auf dem Fortbildungskongress der Frauenärzte, wie KI-Algorithmen das Screening beim Zervix- und Mammakarzinom präzisieren, während im April auf dem DGIM-Kongress diskutiert wurde, wie KI-Lösungen in überfüllten Notaufnahmen die Triage unterstützen können. Ein echter Meilenstein für die klinische Sicherheit war dabei der Oktober: Mit der ersten Leitlinie der ESMO zur Nutzung von Large Language Models (LLM) erhielten Onkologen erstmals einen strukturierten Rahmen, um KI-Tools nicht nur experimentell, sondern leitlinienkonform einzusetzen.

Doch Technik ist das eine – der ärztliche Umgang damit das andere. 2025 wurde intensiv darüber diskutiert, wie der Berufsstand die Hoheit über die Algorithmen behält. Der 129. Deutsche Ärztetag in Leipzig sendete im Juni ein klares Signal: KI wird ärztliche Aufgaben übernehmen, aber die Letztverantwortung muss zwingend beim Menschen bleiben. Dass diese Verantwortung geschult werden muss, thematisierten wir im Frühjahr mit Blick auf die medizinische Ausbildung, die sich von personalisierten Lernpfaden bis hin zum Training mit „virtuellen Patienten“ radikal wandelt. Gleichzeitig schärfte sich der Blick für vulnerable Gruppen. Im September widmeten wir uns den speziellen ethischen Herausforderungen in der Pädiatrie, denn Kinder sind keine kleinen Erwachsenen – auch nicht in den Datensätzen der KI. Hier zeigte sich, dass Algorithmen, die primär an Erwachsenendaten trainiert wurden, kritisch hinterfragt werden müssen.

Hinter den Kulissen rückte in der zweiten Jahreshälfte vermehrt die Frage der Infrastruktur in den Fokus. Diverse Analysen, unter anderem von McKinsey, machten deutlich, dass die aktuelle Dynamik von vielen spezialisierten „Insellösungen“ geprägt ist. Die Erkenntnis des Jahres lautet hier: Ohne eine modulare Plattform-Architektur, die Daten sicher und interoperabel verknüpft, droht die digitale Medizin in einer Sackgasse zu landen. Dazu passt auch die technologische Entwicklung hin zu „multimodalen Modellen“, die Text, Bild und Omics-Daten gleichzeitig verarbeiten können – ein Gamechanger für die Forschung, den wir im September beleuchteten. Dennoch bleibt die Ambivalenz bestehen: Der JAMA Summit on AI beschrieb die Disruption des Gesundheitswesens treffend als „Dr. Jekyll und Mr. Hyde“ – voller Chancen für Effizienz und Präzision, aber auch voller Risiken für Datenschutz und ärztliche Autonomie.

KI ist 2025 endgültig vom Hype-Thema zum Werkzeug geworden. Die Herausforderung besteht nun weniger in der technologischen Machbarkeit, sondern in der sinnvollen Integration in bestehende Abläufe und der kritischen Validierung der Ergebnisse. Für die Praxis heißt das: Neugierig bleiben, aber die ärztliche Skepsis nicht ablegen.

Wir werden die weitere Entwicklung auch im kommenden Jahr genau beobachten und für Sie einordnen.

Text: Redaktion arztCME

Bildquelle: Erstellt mit KI (Google Gemini)