Eine amerikanische Studie untersuchte, wie kommerzielle große Sprachmodelle (LLMs) verbale Wahrscheinlichkeitsbegriffe interpretieren, die zur Vermittlung medizinischer Risiken verwendet werden.

Große Sprachmodelle wie ChatGPT, Gemini, Grok oder Claude werden zunehmend auch für Gesundheitsfragen genutzt. Eine aktuelle Studie zeigt jedoch, dass diese Systeme erhebliche Schwächen haben, wenn es um die Vermittlung medizinischer Wahrscheinlichkeiten geht. Genau darin liegt ein relevantes Risiko für die Patientenkommunikation.

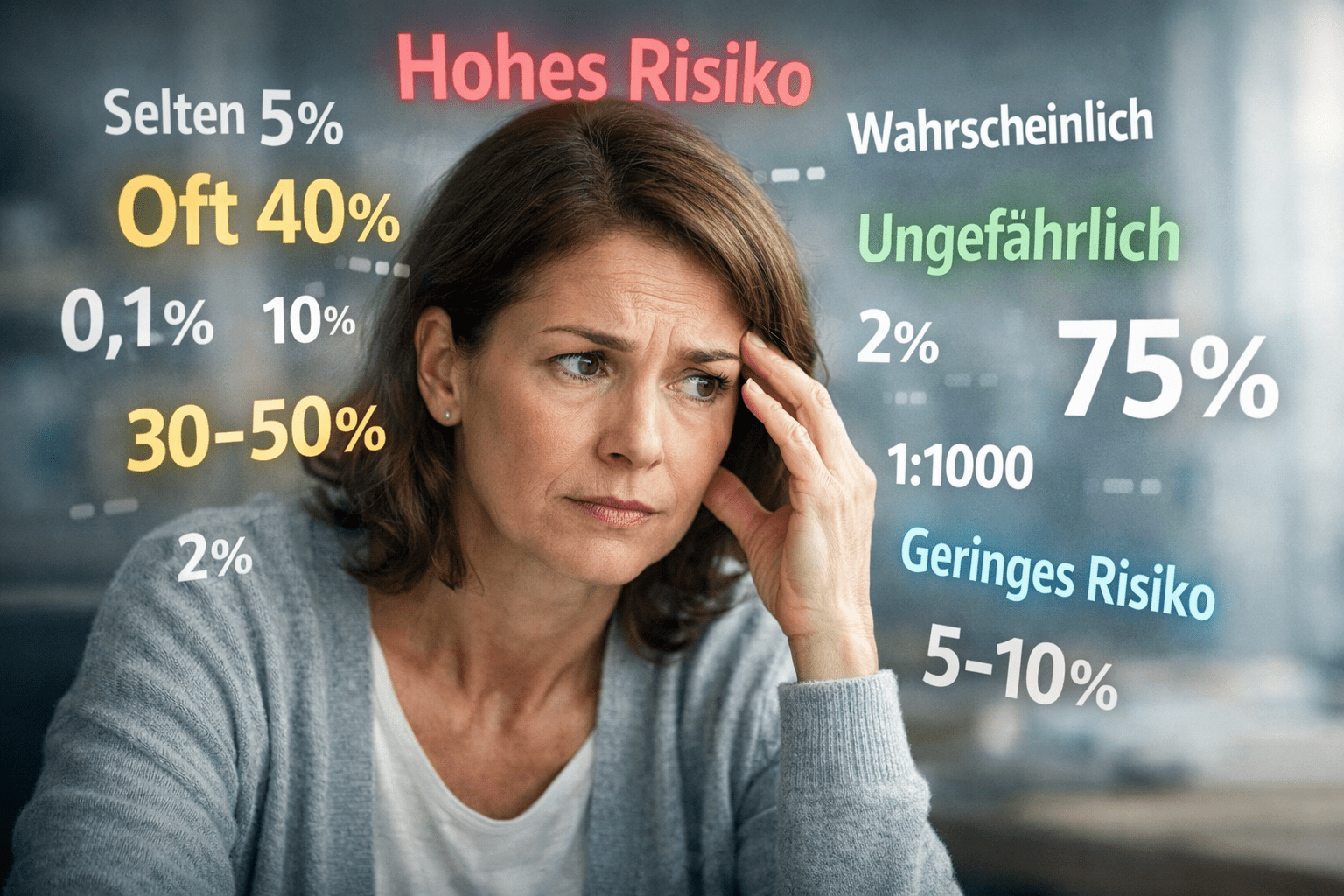

Die im JAMA Network veröffentlichte Studie (Link) untersuchte, wie vier kommerzielle Large Language Models zehn gebräuchliche verbale Wahrscheinlichkeitsbegriffe wie „selten“, „häufig“ oder „wahrscheinlich“ interpretieren. Solche Formulierungen werden in der Medizin und Pharmakovigilanz regelmäßig verwendet, von Patientinnen und Patienten aber sehr unterschiedlich verstanden. Die Autoren wollten wissen, ob LLMs eher regulatorische Definitionen – etwa die Vorgaben der Europäischen Kommission – oder eher alltagsnahe, laienhafte Bedeutungen wiedergeben.

Das zentrale Ergebnis: Die Modelle lieferten häufig GAR KEINE konkrete numerische Einschätzung. Dieses Verhalten nahm vor allem dann zu, wenn die geschilderte klinische Situation schwerwiegender war oder die Anfrage ängstlich formuliert wurde. Wenn die Systeme dennoch Zahlen nannten, orientierten sie sich meist stärker an Laienvorstellungen als an medizinisch-regulatorischen Standards. So wurde der Begriff „häufig“ von allen Modellen deutlich höher eingeschätzt, als es die europäische Leitlinie für Nebenwirkungsangaben vorsieht.

Für die Praxis bedeutet das: LLMs können Missverständnisse in der Risikokommunikation nicht nur übernehmen, sondern sogar verstärken. Gerade in der Aufklärung über Therapieeffekte, Nebenwirkungen oder Prognosen ist das problematisch. Positiv war, dass Antworten bei höherer emotionaler Belastung oft länger und besser lesbar ausfielen. Das könnte auf eine gewisse Anpassungsfähigkeit der Systeme an die Kommunikationssituation hindeuten.

Dennoch bleibt die Kernaussage klar: Ohne technische Leitplanken und standardisierte Vorgaben sind LLMs derzeit keine verlässlichen Werkzeuge für die präzise Kommunikation medizinischer Wahrscheinlichkeiten. Es bleibt viel zu tun, bevor LLMs sicher in patientennahe Kommunikationsprozesse integriert werden können.

Text: Reinhard Merz

Bild: chatGPT für arztCME